Last Updated on noviembre 26, 2025 9:37 pm by Laszlo Szabo / NowadAIs | Published on noviembre 26, 2025 by Laszlo Szabo / NowadAIs

¿Qué es el modelo generador de imágenes FLUX.2 AI? – Sección de notas clave

-

Cambio de arquitectura: FLUX.2 se aleja de los modelos de difusión tradicionales y adopta una arquitectura de correspondencia de flujo latente combinada con un modelo de lenguaje visual (VLM) de 24.000 millones de parámetros. Este cambio proporciona velocidades de generación significativamente más rápidas (inferiores a 10 segundos) y una mejor comprensión semántica, lo que mejora la comprensión del modelo de la física del mundo real y las complejas restricciones de composición. Este rediseño fundamental es esencial para lograr la previsibilidad de la producción.

-

Control y fidelidad de la producción: El sistema ofrece una calidad visual de vanguardia, compatible con salidas y ediciones de hasta 4 megapíxeles, al tiempo que destaca en la retención de detalles y el fotorrealismo. Entre las funciones profesionales clave se incluyen la renderización de texto fiable y de alta fidelidad para tipografía y logotipos, junto con controles de precisión como la orientación directa de la pose y las indicaciones JSON estructuradas para flujos de trabajo programáticos.

-

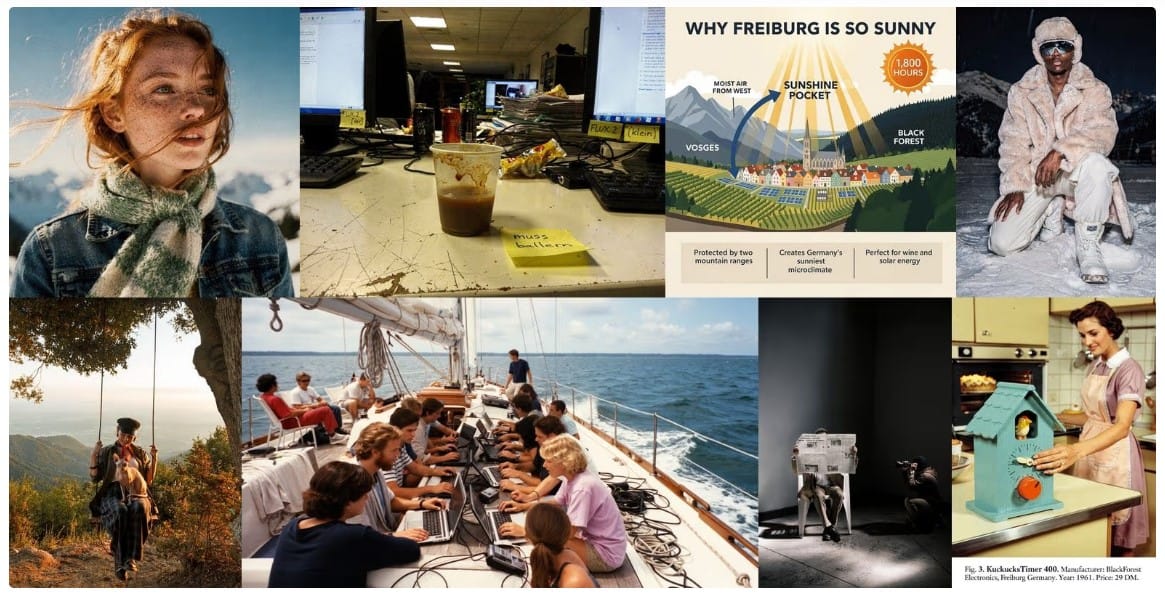

Coherencia multirreferencia: Una característica fundamental es la capacidad de utilizar hasta diez imágenes de referencia simultáneamente, que se integra de forma nativa en la arquitectura para lograr una coherencia sin precedentes en la identidad de los personajes, la apariencia de los productos y el estilo visual en múltiples activos generados. Esta capacidad elimina eficazmente un importante cuello de botella en la creación de campañas comerciales unificadas a gran escala.

-

Accesibilidad y variantes: Black Forest Labs ofrece tres variantes principales: FLUX.2 [pro] para un servicio de API gestionado con la máxima velocidad y calidad, FLUX.2 [flex] para desarrolladores que necesitan un control granular sobre parámetros como los pasos de inferencia, y el FLUX.2 [dev] de peso abierto y 32.000 millones de parámetros [dev] de peso abierto. El modelo FLUX.2 [dev] ha sido optimizado con cuantificación FP8 en colaboración con NVIDIA y ComfyUI, lo que lo hace accesible en GPU de consumo a pesar de su inmenso tamaño. El enfoque por niveles responde a las diversas necesidades de los usuarios, desde las empresas hasta la investigación.

El arquitecto invisible: Por qué FLUX.2 está remodelando el tejido mismo de la creación visual

La era actual de la inteligencia artificial generativa se caracteriza por avances exponenciales en la fidelidad visual, pero los cambios más importantes no se producen en la imagen final, sino en la ingeniería subyacente que la hace posible. Black Forest Labs ha lanzado recientemente FLUX.2, un sistema que eleva de forma silenciosa pero profunda el nivel de la inteligencia visual de producción, sacando la tecnología del ámbito del arte experimental y situándola firmemente en el exigente mundo centrado en el flujo de trabajo de los estudios creativos profesionales. No se trata de una mera actualización de un modelo anterior, sino que el equipo de desarrollo ha rediseñado por completo la arquitectura, sentando las bases para una comprensión mucho más profunda de la física del mundo real, la lógica espacial y las limitaciones comerciales. La ambición aquí no es simplemente crear imágenes que parezcan plausibles, sino crear imágenes que sean predecibles, controlables y fiables a través de campañas comerciales enteras, cambiando fundamentalmente la economía de la creación de activos visuales.

En el corazón del sistema FLUX.2 hay una nueva y sofisticada arquitectura que se aparta significativamente del paradigma del modelo de difusión tradicional que ha dominado este campo durante varios años. En lugar de basarse en un proceso gradual de eliminación de ruido paso a paso, el modelo emplea una arquitectura de correspondencia de flujo latente que aprende un camino más directo y eficiente entre un estado latente ruidoso y un estado latente de imagen limpia. Este enfoque racionalizado es intrínsecamente más rápido y más eficiente desde el punto de vista computacional, lo que se traduce directamente en una latencia y un coste menores para los usuarios de API que trabajan con grandes volúmenes de activos. La arquitectura combina un Modelo de Visión-Lenguaje (VLM) de 24.000 millones de parámetros, derivado de la serie Mistral-3, con un transformador de flujo rectificado, lo que proporciona al sistema una base semántica y una comprensión mucho mayor de la lógica espacial y de composición. El VLM proporciona el conocimiento del mundo real -comprende cómo deben comportarse los objetos y cómo reflejan la luz los materiales-, mientras que el transformador garantiza que los elementos complejos se coloquen de forma correcta y coherente dentro del encuadre, lo que resuelve un problema que existía desde hace tiempo en los modelos generativos, en los que las indicaciones complejas solían dar lugar a un efecto de “pizarra de ambiente” desordenado.

La filosofía de diseño de FLUX.2 se centra en resolver la tensión entre velocidad y calidad, una disyuntiva que históricamente ha afectado a los sistemas generativos. Gracias a la adopción de un sistema central de correspondencia de flujos, Black Forest Labs ha conseguido una calidad de imagen de vanguardia que rivaliza con los mejores modelos de código cerrado y, al mismo tiempo, una velocidad de generación inferior a los 10 segundos. Este perfil de rendimiento lo hace especialmente adecuado para aplicaciones comerciales de alto rendimiento, como la visualización de productos en el comercio electrónico y las campañas de marketing a gran escala, en las que se necesitan cientos o incluso miles de imágenes coherentes y de alta fidelidad en plazos ajustados. Ahora, el sistema puede producir de forma fiable resultados con una impresionante resolución de 4 megapíxeles, un requisito clave para los activos de calidad profesional que deben resistir un escrutinio minucioso y una presentación detallada. Además, el modelo se ha entrenado para mantener específicamente la coherencia de los materiales, la estabilidad de la iluminación y la corrección de la física, lo que ayuda a eliminar el delator “aspecto de IA” que puede socavar la credibilidad de un activo visual en un contexto profesional.

La nueva arquitectura: Un enfoque unificado para la generación y edición de imágenes

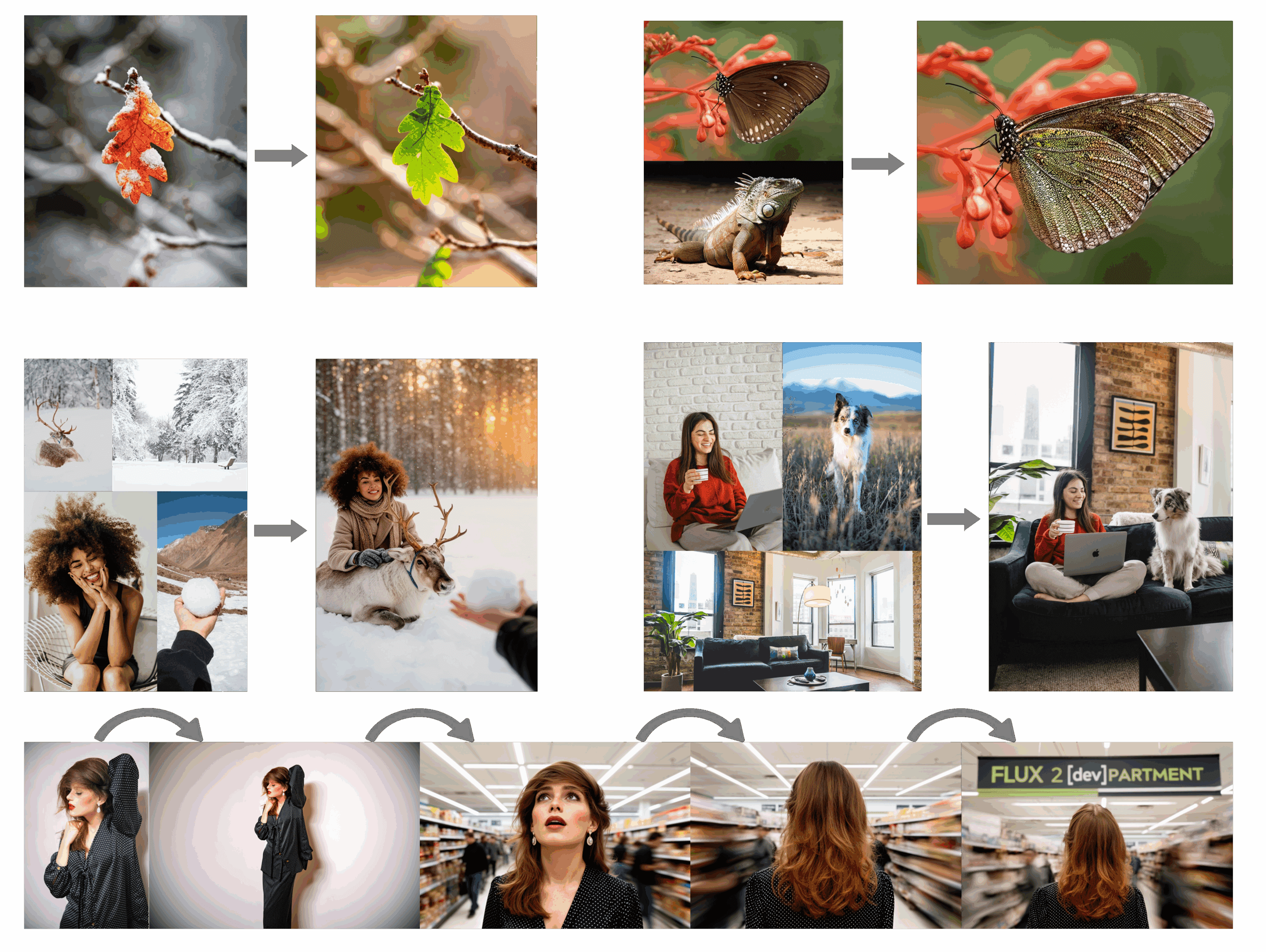

Uno de los logros técnicos más notables de FLUX. 2 es su capacidad para unificar tanto la generación de texto a imagen como la edición de imágenes dentro de una arquitectura única y coherente, eliminando la necesidad de modelos o puntos de control separados para diferentes tareas. Este enfoque basado en un único punto de control simplifica el despliegue y la gestión del modelo, sobre todo para los desarrolladores que crean aplicaciones a partir de la API del sistema. La naturaleza unificada del modelo significa que las modificaciones se realizan con el mismo conocimiento profundo del mundo y razonamiento espacial utilizados para la generación inicial, lo que da como resultado modificaciones mucho más coherentes y que preservan la integridad de la geometría y la textura de la imagen original. Esta capacidad es especialmente evidente en el rendimiento del modelo en la edición de alta resolución, donde los sistemas generativos anteriores solían tener problemas, lo que provocaba lo que suele denominarse “colapso de la textura” o la aparición de nuevos detalles no deseados durante las modificaciones de grandes áreas.

La introducción de un sólido soporte multirreferencia supone otro importante paso adelante, ya que permite a los usuarios introducir hasta diez imágenes de referencia diferentes simultáneamente para guiar el resultado final. Esta sofisticada función está integrada en la arquitectura de FLUX.2, que procesa y fusiona estas incrustaciones visuales de forma coherente antes de la fase de generación. Para los profesionales creativos, esto se traduce en un control sin precedentes sobre la coherencia de los activos, lo que les permite mantener de forma fiable la identidad de un personaje, el aspecto específico de un producto o un estilo visual único en docenas de escenas o composiciones diferentes. Esto resuelve uno de los principales problemas de la producción, en la que el mantenimiento de la coherencia ha requerido tradicionalmente complicados y lentos procesos de ajuste o capas de herramientas externas. La función multirreferencia es esencial para mantener la integridad de la marca y la continuidad de los personajes a lo largo de toda una campaña comercial, y ofrece un nivel de fiabilidad hasta ahora inexistente en los modelos generativos.

Precisión y profesionalidad: Dominio de la tipografía y la composición con FLUX.2

Durante muchos años, el talón de Aquiles de los modelos texto-imagen ha sido su pésimo rendimiento a la hora de generar texto legible, logotipos o elementos de interfaz de usuario. La tipografía generativa solía aparecer en forma de glifos sin sentido o letras desordenadas, un defecto que descalificaba inmediatamente los resultados para su uso en diseño profesional, publicidad y maquetas de experiencia de usuario. Los desarrolladores de FLUX.2 reconocieron esta limitación crítica y pusieron especial énfasis en resolver el problema, lo que ha dado como resultado un sistema que puede representar con fiabilidad tipografía compleja, infografía e incluso texto fino y legible en una escena representada. Esta capacidad mejorada es el resultado directo de la mejora del razonamiento espacial dentro del transformador de flujo, que comprende mejor las relaciones estructurales necesarias para la alineación correcta de la línea de base, el interletraje y el peso de la fuente.

Más allá de la tipografía, el modelo ofrece un conjunto de controles de precisión esenciales para un flujo de trabajo profesional. Entre ellos se incluye la orientación directa de la pose, que permite a los usuarios especificar explícitamente la posición y orientación de los sujetos dentro de la imagen, y la compatibilidad con mensajes estructurados basados en JSON. Las instrucciones estructuradas van más allá de las simples peticiones en lenguaje natural, ya que permiten la especificación programática de elementos de la escena, ajustes de la cámara y restricciones de composición, lo que resulta crucial para crear canales de contenidos escalables y automatizados. La capacidad de posicionar objetos con precisión, mantener un desvanecimiento realista de la luz y garantizar una perspectiva adecuada, incluso en escenas complicadas con varias partes, es lo que realmente diferencia a FLUX.2 de sus predecesores. Este nivel de control granular significa que un director creativo puede solicitar una toma de producto con unas instrucciones técnicas muy específicas y esperar que el modelo se adhiera a ellas con una precisión excepcional, minimizando la necesidad de una extensa corrección posterior a la generación.

Informes de campo y experiencias de los usuarios: El impacto práctico de FLUX.2

Las distintas versiones de FLUX .2, incluida la API gestionada FLUX.2 [pro]la versión personalizable FLUX.2 [flex]y la versión de peso abierto FLUX.2 [dev]han sido puestos a prueba de inmediato por las comunidades de desarrolladores y creadores. Los primeros comentarios de los usuarios que ejecutan el modelo en plataformas asociadas y entornos locales destacan una clara mejora tanto de la calidad del resultado final como de la previsibilidad del proceso creativo. Un desarrollador, que escribe en un foro técnico sobre su trabajo con FLUX.2 [flex] API, afirmaba,

“La posibilidad de ajustar el número de pasos de inferencia para borradores rápidos (pasos bajos) y alcanzar el máximo para el renderizado final (pasos altos) sin cambiar de modelo ha agilizado nuestro ciclo de creación de prototipos en más de un 30%. El detalle de los tejidos y los rostros es simplemente mejor que el que obteníamos antes con cualquier modelo”

Este nivel de control sobre los parámetros de generación -que permite al usuario cambiar la velocidad por la máxima precisión- está siendo elogiado por equipos cuyo trabajo requiere una fidelidad extrema.

El FLUX.2 [dev] un importante modelo de 32.000 millones de parámetros, también ha recibido una gran atención, sobre todo por parte de la comunidad de entusiastas del hardware. Aunque el modelo es exigente desde el punto de vista computacional y requiere hasta 90 GB de VRAM para la inferencia de precisión completa, la colaboración entre Black Forest Labs, NVIDIA y el equipo de ComfyUI ha dado lugar a implementaciones cuantificadas FP8 que pueden ejecutarse en GPU GeForce RTX de consumo. Un conocido modder de la comunidad señaló en Reddit,

“Estamos ejecutando los puntos de control FP8 con la transmisión de peso mejorada de ComfyUI y, aunque está sobrecargando mi tarjeta de 24 GB, la calidad y la nitidez del texto renderizado merecen absolutamente la pena. Se siente como el primer modelo abierto que está realmente construido para uso profesional, no sólo para demos impresionantes”

Esta accesibilidad, conseguida mediante una sofisticada optimización, es fundamental, ya que amplía la base de investigadores y desarrolladores que pueden contribuir e innovar con la tecnología FLUX.2. El consenso obtenido en las pruebas prácticas iniciales sugiere que los avances fundamentales -especialmente la coherencia multirreferencia y la fidelidad superior del texto- no son promesas académicas, sino capacidades demostrables que ya se están integrando en los procesos comerciales.

El paso filosófico: De la eliminación de ruido a la comprensión con FLUX.2

El impacto de la arquitectura FLUX. 2 va más allá de las meras especificaciones técnicas; representa un cambio conceptual en la forma de diseñar los sistemas visuales generativos. El modelo se basa en una columna vertebral de correspondencia de flujos latentes que, combinada con su sofisticado modelo de lenguaje visual, aleja al sistema de la mera generación de píxeles y lo acerca más a la comprensión real del mundo semántico y físico que simula. La capacidad del sistema para procesar hasta diez referencias visuales y fusionarlas coherentemente en un único resultado novedoso es un testimonio de su elevado conocimiento del mundo. El proceso de entrenamiento, que incluyó un reentrenamiento completo del espacio latente del autoencoder variacional (VAE) desde cero, fue un esfuerzo meticuloso para lograr simultáneamente una mejor capacidad de aprendizaje y una mayor calidad de imagen, un equilibrio crítico al que a menudo se hace referencia como el trilema “capacidad de aprendizaje-calidad-compresión”. El nuevo espacio latente VAE en el que se basa FLUX.2 tiene una mayor relación señal-ruido, es más compresible y, lo que es más importante, el modelo aprende más fácilmente de él, lo que es clave para mantener los detalles y la estructura durante las ediciones de alta resolución.

En el contexto más amplio de la inteligencia visual, FLUX.2 se posiciona como una pieza fundacional de la infraestructura, insinuando un futuro en el que los modelos visuales se integren en motores multimodales más amplios capaces de percepción, memoria y razonamiento. La iteración actual ya admite la impresionante cantidad de 32.000 tokens de entrada de texto, lo que permite instrucciones creativas increíblemente verbosas y detalladas, una capacidad que refleja el intento de construir un sistema que pueda manejar indicaciones verdaderamente complejas y narrativas. El modelo no se limita a interpretar las palabras de la instrucción de forma aislada, sino que aprovecha su VLM para fundamentar la petición en la lógica del mundo real, razón por la cual los objetos mantienen una física adecuada, los reflejos se comportan de forma realista y las sombras caen correctamente. Este compromiso con la precisión física y espacial hace que los activos generados por FLUX. 2 sean intrínsecamente más adecuados para aplicaciones como la visualización arquitectónica, las maquetas de productos y la preproducción de efectos visuales, donde la precisión es primordial. En definitiva, la meticulosa ingeniería y el completo conjunto de funciones de FLUX. 2 marcan un nuevo estándar para las herramientas visuales generativas profesionales, ofreciendo una base sólida, controlable y fiable para la próxima generación de procesos creativos.

Sección de definiciones

-

Emparejamientode flujo latente: Un tipo específico de arquitectura de modelo generativo que difiere de los modelos de difusión tradicionales. En lugar de invertir gradualmente un proceso de ruido a lo largo de muchos pasos, la correspondencia de flujo aprende una ruta directa y continua (un “flujo rectificado”) entre un estado de ruido simple y un estado de datos complejo en el espacio latente. Este proceso suele ser más eficaz y permite una generación más rápida y estable. El mecanismo central es responsable de la velocidad y la calidad de FLUX.2.

-

Modelo Visión-Lenguaje (VLM): Un modelo de IA multimodal que es competente tanto en la comprensión y generación de lenguaje (texto) como en el procesamiento de datos visuales (imágenes). En el contexto de FLUX.2, el componente VLM proporciona al modelo “conocimiento del mundo” y comprensión semántica, garantizando que las escenas generadas sigan reglas físicas y contextuales realistas.

-

Cuantización FP8: Técnica utilizada para optimizar grandes modelos de IA para su uso en hardware más limitado. La cuantización reduce la precisión de la representación numérica de los pesos del modelo, en este caso, de la coma flotante estándar de 32 bits (FP32) a la coma flotante de 8 bits (FP8). Esto reduce drásticamente la memoria (VRAM) y los recursos computacionales necesarios para ejecutar el enorme FLUX.2 [dev] lo que lo hace viable en las GPU de consumo.

-

Autoencoder variacional (VAE): Un tipo de red neuronal que se utiliza en modelos generativos para comprimir los datos de imágenes de alta dimensión en una representación “latente” más pequeña y manejable y, a continuación, descodificarla de nuevo en una imagen completa. El espacio latente de VAE en FLUX.2 se ha reentrenado para equilibrar la compresión con la calidad de la señal, lo que es crucial para permitir la generación y edición en alta resolución (hasta 4 MP) sin pérdida de detalle.

-

Instrucciones estructuradas (basadas en JSON): Un método avanzado para proporcionar instrucciones al modelo generativo, que va más allá del simple texto en lenguaje natural. Utiliza un formato de datos estructurado como JSON para definir y restringir explícitamente elementos de la escena, ángulos de cámara, condiciones de iluminación y reglas de composición, lo que permite una generación de activos precisa, programática y repetible, que es una característica clave de la APIFLUX.2 para usuarios empresariales.

Preguntas más frecuentes (FAQ)

- ¿Cuál es la principal diferencia arquitectónica de FLUX.2 con respecto a los modelos anteriores? La principal diferencia de FLUX.2 radica en el uso de una base de correspondencia de flujo latente combinada con un modelo de lenguaje visual de 24.000 millones de parámetros, que va más allá del proceso iterativo de eliminación de ruido de los modelos de difusión tradicionales. Esta arquitectura avanzada permite a FLUX. 2 aprender un camino más directo hacia la imagen final, lo que se traduce en tiempos de generación sustancialmente más rápidos y en una comprensión más profunda de las complejas relaciones semánticas y espaciales, lo que se traduce en una mejor adherencia a las indicaciones y un mayor realismo https://bfl.ai/blog/flux-2.

- ¿Cómo gestiona FLUX.2 la coherencia de la imagen en una serie de imágenes generadas? FLUX.2 aborda la coherencia de las imágenes a través de su sólido soporte multirreferencia, capaz de procesar y fusionar hasta diez imágenes de entrada en un único paso de generación. Esta característica arquitectónica nativa permite al sistema mantener de forma coherente un carácter específico, la identidad de un producto o un estilo visual en numerosas composiciones y escenas diferentes, lo que resulta fundamental para proyectos creativos unificados a gran escala que requieren altos niveles de continuidad.

- ¿La tecnología FLUX.2 de gama alta es accesible para usuarios sin hardware masivo? Aunque el FLUX.2 [dev] es un sistema masivo de 32.000 millones de parámetros que requiere una VRAM considerable, la tecnología se ha hecho más accesible gracias a los esfuerzos de optimización colaborativa. En concreto, el lanzamiento de los puntos de control cuantificados FP8, desarrollados con NVIDIA y ComfyUI, permite que el potente modelo FLUX. 2 se ejecute en GPU de consumo con suficiente descarga de memoria del sistema, lo que amplía la base de investigadores y aficionados que pueden utilizar el modelo.

- ¿Qué mejoras ofrece FLUX.2 para la generación de texto y logotipos? FLUX.2 ofrece una importante mejora en la generación de texto y logotipos al aprovechar su razonamiento espacial mejorado dentro del transformador de flujo, que da como resultado una tipografía fiable, limpia, legible y estructuralmente correcta. Esta capacidad significa que el modelo puede renderizar con precisión textos complejos, infografías y maquetas de interfaz de usuario con el interletraje y la alineación de línea de base adecuados, lo que convierte a FLUX.2 en una herramienta viable para el diseño profesional y la creación de activos de marketing en los que el texto legible es un requisito innegociable.

- ¿Cuál es la ventaja de utilizar avisos estructurados basados en JSON con FLUX.2? La principal ventaja de utilizar avisos estructurados basados en JSON con FLUX. 2 es que se consigue un nivel de control determinista y programático sobre la salida que no es posible sólo con el lenguaje natural. Esta función permite a los usuarios empresariales y a los desarrolladores especificar con precisión los elementos de composición, la posición exacta de los objetos y los detalles específicos de la marca, como los códigos de color HEX, garantizando que los activos generados se adhieran estrictamente a las instrucciones técnicas creativas y puedan integrarse de forma fiable en los flujos de trabajo creativos automatizados.