Last Updated on noviembre 28, 2025 2:13 pm by Laszlo Szabo / NowadAIs | Published on noviembre 28, 2025 by Laszlo Szabo / NowadAIs

Demonios de la velocidad y sueños de silicio: Z-Image-Turbo, el nuevo generador de imágenes de Alibaba – Notas clave

-

Velocidad sin precedentes: el modelo utiliza un proceso optimizado de 8 pasos (NFEs) para lograr una generación de imágenes por debajo del segundo en hardware empresarial, mientras que se mantiene excepcionalmente rápido en GPUs de consumo.

-

Eficiencia del hardware: Diseñado para funcionar dentro de una envolvente VRAM de 16 GB, hace que la generación fotorrealista de alta gama sea accesible en máquinas locales sin requerir costosas suscripciones a la nube.

-

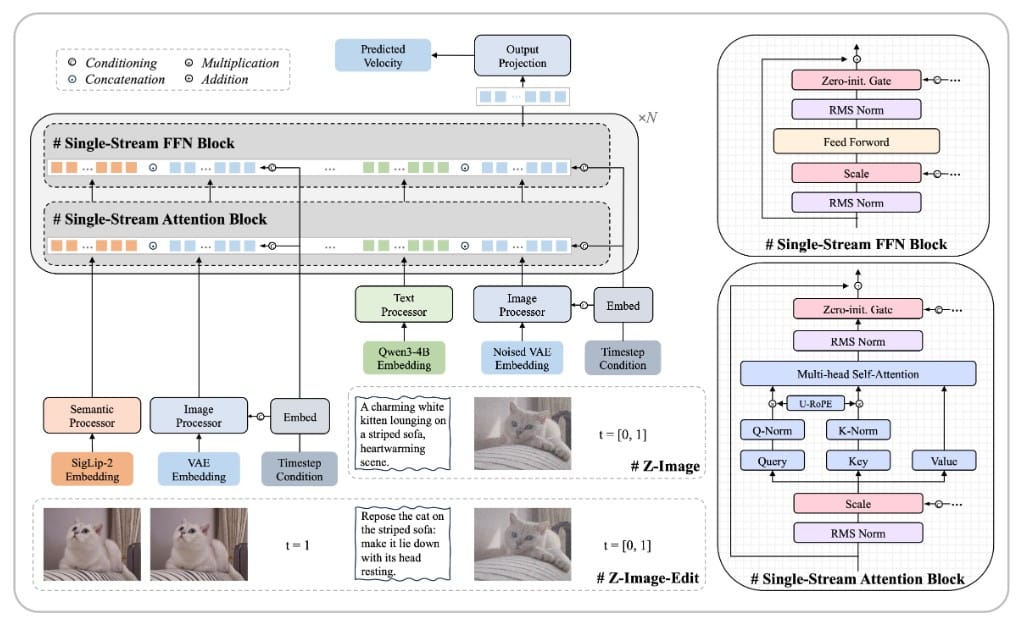

Arquitectura unificada: Emplea un exclusivo transformador de difusión de flujo único escalable (S3-DiT) que procesa los datos de texto y visuales de forma conjunta, mejorando tanto la eficiencia como la comprensión semántica.

-

Dominio bilingüe: El sistema cuenta con un sólido soporte nativo para la representación de texto en inglés y chino, lo que permite una tipografía precisa y avisos complejos y anidados en ambos idiomas.

La necesidad de velocidad en los medios generativos

Noviembre de 2025 ha supuesto un claro cambio en el horizonte de la IA, desplazando la conversación desde la capacidad estética bruta hacia algo mucho más pragmático: la velocidad. Durante años, la disyuntiva era brutal y aparentemente inmutable. Si querías alta fidelidad, pagabas por ella en segundos, a veces minutos, de cambio de GPU. Si querías velocidad, aceptabas el valle misterioso. Esta semana, un comunicado del equipo Tongyi-MAI de Alibaba sugiere que este compromiso ya no es una ley de la física, sino simplemente un obstáculo de ingeniería que se ha superado. La llegada de Z-Image-Turbo marca un momento concreto en el que la eficiencia alcanza por fin a la fidelidad.

La industria se ha hinchado con modelos que requieren granjas de servidores para funcionar eficazmente. Nos hemos acostumbrado al “estilo de vida de la barra de carga”, mirando fijamente los indicadores de progreso mientras un modelo calcula la difusión del ruido en el arte. Esta latencia ha sido el asesino silencioso de la creatividad iterativa. Cuando un creador debe esperar treinta segundos para ver si una indicación ha funcionado, el estado de flujo se rompe. La promesa de Z-Image-Turbo no está sólo en los píxeles que produce, sino en el tiempo que ahorra. Representa un avance hacia la creación “a velocidad de pensamiento”, en la que la distancia entre la concepción y la visualización se mide en milisegundos y no en pausas para el café.

Este cambio no es sólo cuestión de paciencia, sino también de accesibilidad. Al estar optimizado para el hardware de consumo, en concreto el “punto dulce” de 16 GB de VRAM, este modelo democratiza la generación de gama alta. Saca la capacidad de la nube y la devuelve firmemente a la máquina local. Se trata de un giro con respecto a los modelos masivos y monolíticos de 2024, que exigían recursos informáticos exorbitantes, y marca una tendencia hacia arquitecturas más esbeltas e inteligentes que hacen más con menos.

Desembalaje de la arquitectura de Z-Image-Turbo

En el corazón de este rendimiento se encuentra una elección arquitectónica específica conocida como Scalable Single-Stream Diffusion Transformer, o S3-DiT. A diferencia de los modelos de difusión tradicionales, que suelen separar el procesamiento de los datos textuales y visuales en distintos canales que deben sincronizarse laboriosamente, Z-Image-Turbo unifica estos elementos. Concatena los tokens de texto, los tokens semánticos visuales y los tokens VAE de imagen en una única secuencia cohesionada. De este modo, el modelo puede procesar la relación entre el mensaje y la imagen resultante con una sobrecarga computacional significativamente menor.

Las cifras de eficiencia son contundentes. El modelo funciona con sólo 8 números de evaluaciones de funciones (NFE). Para ponerlo en perspectiva, muchos competidores de alta fidelidad necesitan entre 25 y 50 pasos para resolver una imagen coherente. Al reducir el proceso a solo ocho pasos, Z-Image-Turbo logra tiempos de inferencia inferiores a un segundo en hardware empresarial como la H800 y, lo que es más importante, mantiene un rendimiento rápido en tarjetas de consumo como la RTX 3060 o 4090. No se trata de un enfoque de fuerza bruta, sino de una optimización algorítmica que elimina los cálculos redundantes que históricamente han ralentizado los modelos de difusión.

Además, el modelo utiliza un número de parámetros de 6.000 millones. En el contexto actual, 6B se considera un tamaño ligero, casi portátil, y sin embargo supera con creces su categoría en cuanto a calidad de resultados. Los desarrolladores de Tongyi-MAI han utilizado técnicas avanzadas de destilación, es decir, han enseñado a un modelo “alumno” más pequeño a imitar el comportamiento de un modelo “maestro” masivo, para conservar el matiz estético de un sistema más grande sin el consiguiente impuesto sobre el hardware. Este equilibrio de 6 parámetros B y 8 ENF es lo que confiere a Z-Image-Turbo su carácter distintivo en el mercado.

La ventaja bilingüe y el renderizado de texto

Uno de los fracasos persistentes de la IA generativa ha sido su analfabetismo. Durante mucho tiempo, cuando se le pedía a una IA que renderizara un texto, el resultado eran jeroglíficos alienígenas o sinsentidos confusos. Z-Image-Turbo aborda este problema con una sólida capacidad bilingüe que parece una auténtica utilidad más que una novedad. Admite la representación de texto en inglés y chino con un alto grado de precisión. Esta función es especialmente importante para aplicaciones comerciales, como la creación de carteles, portadas de libros o contenidos para redes sociales en los que el texto forma parte integral de la composición.

El codificador de texto subyacente, al parecer basado en la serie de modelos lingüísticos Qwen 3, proporciona al sistema una comprensión más profunda de la estructura del texto. Esto permite a Z-Image-Turbo manejar instrucciones complejas en las que el texto debe colocarse espacialmente dentro de una escena, por ejemplo, “un cartel de neón que diga ‘OPEN’ en un callejón lluvioso” El modelo comprende no sólo los caracteres, sino el contexto en el que deben aparecer. Esto reduce la necesidad de utilizar herramientas externas de posprocesamiento como Photoshop para superponer el texto, lo que agiliza el flujo de trabajo de los diseñadores gráficos que necesitan una ideación rápida.

Esta naturaleza bilingüe también abre la herramienta a una base de usuarios global de forma inmediata. Al tratar las indicaciones en chino e inglés con la misma prioridad, el modelo salva una brecha que a menudo segrega a la comunidad de la IA. Los usuarios pueden introducir instrucciones complejas en chino que describan “una figura vestida de Hanfu que sostiene un pergamino con una caligrafía específica”, y el sistema resuelve la caligrafía correctamente. Este nivel de precisión semántica de Z-Image-Turbo es el resultado directo de la arquitectura de flujo único, que combina estrechamente la comprensión lingüística con la generación visual.

Informes de campo: La experiencia del usuario

Las especificaciones teóricas no tienen sentido sin una aplicación práctica, y los primeros usuarios de Z-Image-Turbo han dado a conocer sus hallazgos. En plataformas como Reddit y Hugging Face, la acogida ha sido una mezcla de asombro por la velocidad y crítica constructiva por la sensibilidad. Un usuario, conocido como “abnormal_human” en el subreddit de FluxAI, ha señalado que el modelo es “notablemente más rápido que sus predecesores”, ya que obtiene imágenes de 2 megapíxeles en sólo 5-6 segundos. Destacan que, aunque la rapidez de respuesta puede ser a veces “impredecible”, la “calidad estética es bastante impresionante nada más sacarlo de la caja” para un modelo de este tamaño.

Otro probador, “lacerating_aura”, realizó pruebas de estrés de resolución y descubrió que Z-Image-Turbo mantenía su coherencia sorprendentemente bien hasta los 6 megapíxeles, una hazaña que suele provocar alucinaciones o fracturas en los modelos más pequeños. Identificaron el rango de 4-5 MP como un “punto dulce” para la calidad, señalando que el uso de VRAM se mantuvo cómodamente por debajo del límite de 16 GB incluso durante estas tareas intensivas. Esto confirma las afirmaciones del desarrollador sobre la eficiencia y sugiere que el modelo es lo suficientemente robusto como para realizar trabajos de calidad de impresión, siempre que el usuario se mantenga dentro de unos límites de resolución razonables fuente.

Sin embargo, la experiencia no está exenta de peculiaridades. Algunos usuarios han señalado que el estricto cumplimiento de las instrucciones puede resultar rígido en ocasiones. Si una indicación es imprecisa, puede que Z-Image-Turbo no “sueñe” de forma tan creativa como otros modelos más antiguos y alucinógenos. Necesita instrucciones claras y estructuradas para brillar. Sin embargo, para los profesionales que necesitan resultados concretos en lugar de accidentes felices, esta previsibilidad es una característica, no un error. El consenso de la comunidad es que esta herramienta es una bestia de carga, diseñada para procesos de producción en los que el tiempo es oro.

Realidades del hardware y acceso de los consumidores

No se puede exagerar la importancia del requisito de 16 GB de VRAM. En la jerarquía de las GPU, el salto de 12 GB o 16 GB a las codiciadas tarjetas de 24 GB (como las RTX 3090 o 4090) supone un enorme salto económico para muchos aficionados y autónomos. Z-Image-Turbo se sitúa cómodamente en la gama media. Esto significa que puede funcionar en un portátil para juegos de gama alta estándar o en un ordenador de sobremesa de gama media. No es necesario alquilar GPU en la nube ni suscribirse a un servicio mensual para acceder a esta tecnología de Inteligencia Artificial.

Esta accesibilidad local garantiza la privacidad y la propiedad. Cuando ejecutas Z-Image-Turbo en tu propia máquina, tus indicaciones y tus resultados siguen siendo tuyos. No hay fuga de datos a un servidor corporativo, una consideración crítica para los estudios que trabajan con IP sensible. La naturaleza de código abierto del modelo, publicado bajo la licencia Apache 2.0, refuerza aún más esta libertad. Permite a los desarrolladores integrar el modelo en sus propias aplicaciones, creando flujos de trabajo personalizados que aprovechan la velocidad de sub-segundo para la interactividad en tiempo real.

Las pruebas indican que el modelo sigue respondiendo incluso en hardware antiguo. Aunque la afirmación de “sub-segundo” se aplica a los chips empresariales H800, la experiencia del consumidor en tarjetas como la RTX 3060 sigue siendo notablemente fluida en comparación con el lento rendimiento de los modelos de 12.000 millones de parámetros. Esta eficiencia se extiende también al consumo de energía. Generar una imagen con 8 pasos consume una fracción de la energía necesaria para una generación de 50 pasos, lo que convierte a Z-Image-Turbo en una opción más ecológica para los usuarios intensivos que generan miles de imágenes a diario.

Análisis comparativo: El debate entre velocidad y calidad

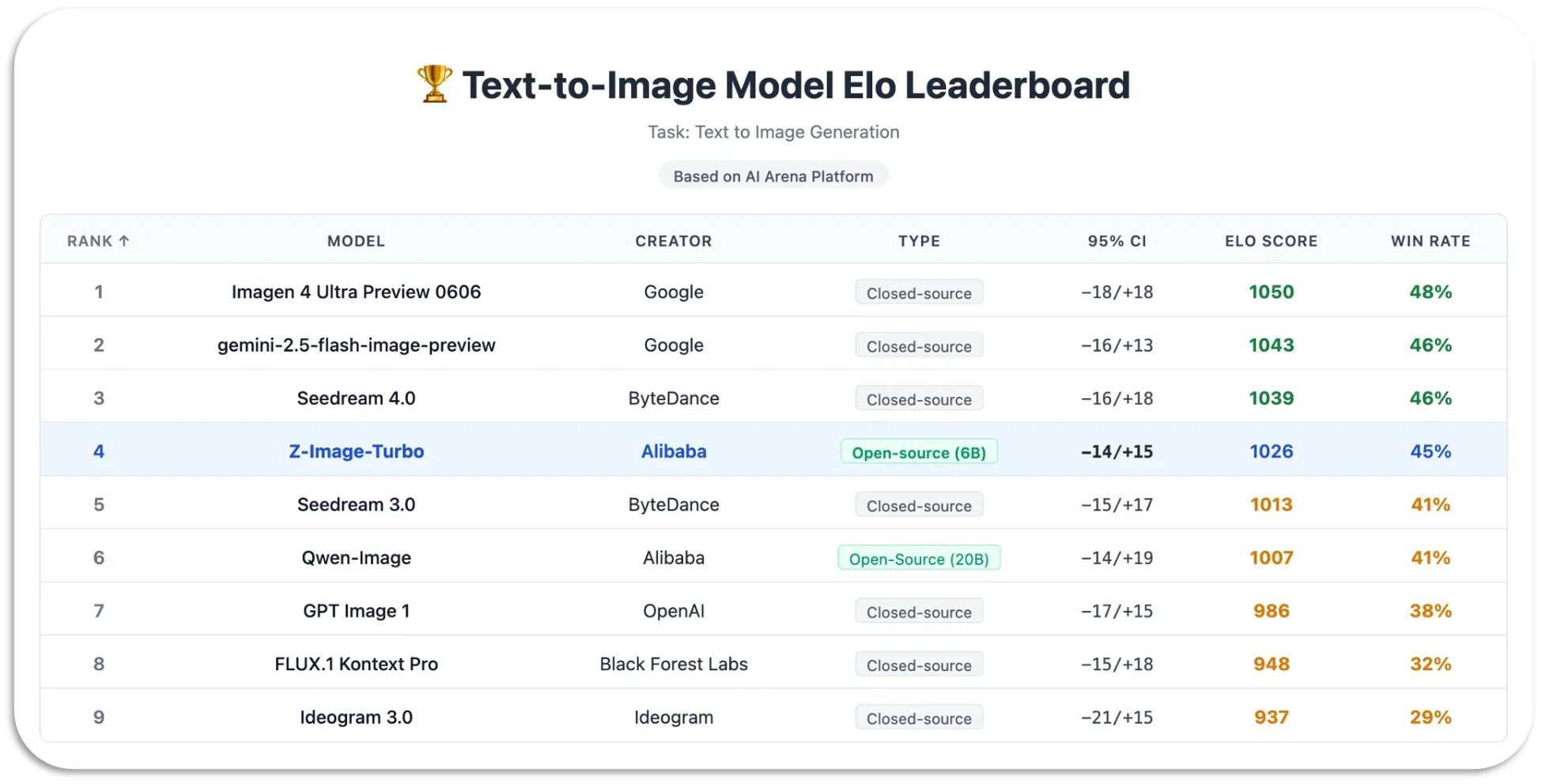

Cuando se comparan con titanes como Flux o Midjourney, las diferencias son evidentes. Esos modelos dan prioridad a la densidad perfecta de píxeles y al estilo artístico, a menudo a costa de la velocidad y el peso computacional. Z-Image-Turbo toma un camino diferente. No intenta superar a Midjourney en pura abstracción artística, sino que aspira a ser el camino más rápido hacia un resultado fotorrealista. Es la diferencia entre un concept car y un coche de carreras. Uno es para el espectáculo; el otro, para el rendimiento.

El fotorrealismo de Z-Image-Turbo es realista y nítido. Destaca en las texturas de la piel, la iluminación y los materiales físicos, probablemente debido a la alta calidad de sus datos de entrenamiento. Mientras que algunos modelos artísticos tienden a sobreestilizar o “cocinar” una imagen con una saturación excesiva, este modelo se inclina hacia el naturalismo. Esto lo hace especialmente peligroso para el mercado de la fotografía de archivo. Si un usuario puede generar una imagen hiperrealista de “una reunión de negocios en una oficina moderna” en 0,8 segundos, la propuesta de valor de desplazarse por las bibliotecas de stock disminuye rápidamente.

También está el factor de la “dirigibilidad” Como el bucle de generación es tan estrecho, los usuarios pueden iterar sobre una indicación diez veces en el lapso que tardaría otro modelo en generar una imagen. Este rápido bucle de retroalimentación permite un tipo diferente de creatividad, basada en el refinamiento y el ajuste más que en la suerte ciega. Z-Image-Turbo permite una conversación con la IA, en la que el usuario habla y la máquina responde al instante, lo que permite corregir el rumbo en tiempo real, algo que antes era imposible con el hardware local.

Trayectorias futuras de los modelos destilados

El lanzamiento de este modelo señala una tendencia más amplia del sector: la era de los modelos masivos y difíciles de manejar está dando paso a la era de la eficiencia destilada. Estamos asistiendo a una evolución hacia modelos especializados y más pequeños, más fáciles de manejar y de ajustar. Z-Image-Turbo es probablemente la primera de muchas variantes “Turbo” que veremos en diferentes modalidades, desde el vídeo al audio. El éxito de este proceso de destilación demuestra que el número de parámetros no es la única métrica que importa.

De cara a 2026, las implicaciones de Z-Image-Turbo se dejarán sentir probablemente en la integración de software. Podemos esperar ver este modelo, o derivados de su arquitectura, integrados directamente en software creativo como Photoshop, Blender o incluso procesadores de texto. Cuando el coste de generación es tan bajo y la velocidad tan alta, la generación de IA deja de ser una tarea independiente y se convierte en una función dentro de otros flujos de trabajo. Se vuelve invisible, instantánea y ubicua.

En definitiva, Z-Image-Turbo es una declaración de intenciones. Defiende que el arte de la IA de alta calidad no debe quedar encerrado tras muros de pago o colas de servidores. Devuelve el poder de la generación al borde, al dispositivo del usuario, sin pedirle que actualice su fuente de alimentación. Es una herramienta creada para la realidad del trabajo creativo moderno: rápida, flexible y eficaz sin concesiones. Para el creador que valora su tiempo tanto como sus píxeles, este puede ser el lanzamiento más importante del año.

Definiciones

-

NFE (Número de evaluaciones de funciones): Una métrica que se refiere al número de pasos o “miradas” que el modelo de IA necesita para refinar una imagen ruidosa y convertirla en una imagen clara. Un menor número de NFE significa que el modelo funciona más rápido.

-

Destilación: Proceso de aprendizaje automático en el que un modelo “alumno” más pequeño y rápido se entrena para replicar el rendimiento y los conocimientos de un modelo “maestro” mucho más grande y lento, conservando la calidad y reduciendo el tamaño.

-

VRAM (memoria de acceso aleatorio a vídeo): La memoria dedicada de una tarjeta gráfica que se utiliza para almacenar datos de imágenes y parámetros de modelos. Es el principal cuello de botella en la ejecución local de modelos de IA.

-

S3-DiT (Scalable Single-Stream Diffusion Transformer): Una arquitectura de red neuronal específica que combina el procesamiento de texto e imágenes en un solo flujo, en lugar de separarlos, para aumentar la velocidad y la coherencia.

-

Inferencia: Fase en la que un modelo de IA entrenado se pone a trabajar para generar una salida (como una imagen) a partir de una entrada (como un texto).

-

Fotorrealismo: Estilo de generación en el que el resultado es indistinguible de una fotografía tomada con una cámara, centrándose en la iluminación, la textura y la física realistas.

-

Latencia: El tiempo que transcurre entre el envío de una solicitud (la petición) y la recepción del resultado (la imagen). Una latencia más baja significa una experiencia más receptiva.

Preguntas más frecuentes (FAQ)

- ¿Puedo utilizar Z-Image-Turbo en mi portátil para juegos? Sí, probablemente sí. Z-Image-Turbo se ha optimizado específicamente para ejecutarse en hardware de consumo con 16 GB de VRAM, lo que significa que los portátiles para juegos de gama alta y los ordenadores de sobremesa de gama media pueden utilizarlo eficazmente.

- ¿Cómo se compara Z-Image-Turbo con Midjourney en términos de calidad? Mientras que Midjourney suele centrarse en el estilo artístico y la abstracción, Z-Image-Turbo prioriza el fotorrealismo y el estricto cumplimiento de los plazos. Produce imágenes altamente realistas mucho más rápido, aunque puede tener un “sabor” estético diferente al estilizado resultado de Midjourney.

- ¿Se puede utilizar libremente Z-Image-Turbo para proyectos comerciales? El modelo se ha publicado bajo la licencia Apache 2.0, que generalmente permite el uso comercial. Esto convierte a Z-Image-Turbo en una excelente opción para estudios y autónomos que buscan integrar la generación de IA en sus procesos profesionales sin tener que pagar licencias restrictivas.

- ¿Por qué Z-Image-Turbo se considera más rápido que otros modelos? Utiliza una arquitectura destilada que requiere sólo 8 pasos (NFEs) para generar una imagen completa, mientras que muchos competidores requieren de 25 a 50 pasos. Esta reducción de los pasos de cálculo permite a Z-Image-Turbo ofrecer resultados en una fracción del tiempo.

Fuentes

https://replicate.com/prunaai/z-image-turbo

https://zimageturbo.org/z-image-open-source

https://huggingface.co/Tongyi-MAI/Z-Image-Turbo

https://www.reddit.com/r/FluxAI/comments/1p7m8nd/z_image_turbo_seems_promising_what_do_you_think/

https://www.reddit.com/r/StableDiffusion/comments/1p7ruhk/zimageturbo_generation_resolution_testing/

https://blog.comfy.org/p/z-image-turbo-in-comfyui-realism

https://github.com/Tongyi-MAI/Z-Image

https://civitai.com/models/2168935/z-image

https://www.aibase.com/news/23161

https://huggingface.co/mrfakename/Z-Image-Turbo