Google ha puesto en marcha una iniciativa interna llamada “TorchTPU” con un objetivo singular: lograr que sus Unidades de Procesamiento Tensorial (TPU) sean totalmente compatibles con PyTorch. Este movimiento busca romper el monopolio y control que NVIDIA ejerce a través de CUDA en el ecosistema de desarrollo de inteligencia artificial.

**Por qué es importante.** NVIDIA se ha convertido en la empresa con mayor capitalización bursátil del mundo por dos grandes razones: sus GPUs especializadas en IA y, aún más crucial, CUDA. Esta plataforma de software, utilizada masivamente por desarrolladores, tiene una peculiaridad estratégica: solo funciona en chips de la propia NVIDIA, creando un ecosistema cerrado.

**Qué pasa con Google y sus TPUs.** Hasta ahora, las TPUs de Google estaban optimizadas principalmente para Jax, un framework propio. Sin embargo, la mayoría de la industria utiliza PyTorch, que lleva años optimizándose gracias a CUDA. Esta incompatibilidad ha representado una barrera de entrada significativa para que las TPUs compitan en el mercado general.

**Meta está en el ajo.** Según fuentes anónimas citadas por Reuters, Google se ha aliado con Meta para acelerar el desarrollo de TorchTPU. Esta colaboración es especialmente significativa porque fue Meta quien creó originalmente PyTorch. La empresa de Mark Zuckerberg tiene un interés claro: que las TPUs de Google ofrezcan una alternativa viable para reducir sus elevados costes de infraestructura en IA.

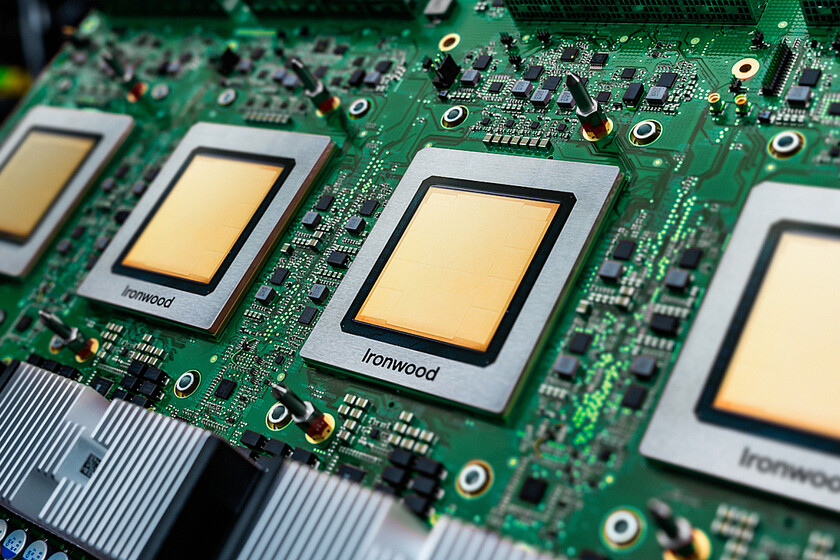

**Google como potencial gigante de chips de IA.** La empresa liderada por Sundar Pichai ha dado un giro estratégico con sus TPUs. Mientras que antes eran de uso exclusivo interno, desde 2022 la división de Google Cloud ha tomado el control de su comercialización, convirtiéndolas en un motor de ingresos fundamental y en un competidor directo en el mercado de hardware para IA.

**Todos contra NVIDIA.** Esta alianza Google-Meta es el último intento de desafiar la ventaja competitiva de NVIDIA. Recientemente hemos visto iniciativas similares, como los esfuerzos de Huawei para crear un ecosistema alternativo a CUDA, o la colaboración de varias empresas chinas de IA con el mismo objetivo.

**El hardware importa, el software importa más.** CUDA se ha convertido en un componente tan crítico que la incapacidad de otros fabricantes para competir con NVIDIA no se debe principalmente a la calidad de sus chips, sino a la falta de un ecosistema de software comparable. Un ejemplo claro es AMD, cuyas GPUs para IA son excepcionales, pero cuyo software no alcanza el nivel de integración y adopción de CUDA.

**REDACCIÓN FV MEDIOS**