mistral AI y NVIDIA lanzan el modelo 12B NeMo

Last Updated on julio 26, 2024 12:44 pm by Laszlo Szabo / NowadAIs | Published on julio 24, 2024 by Laszlo Szabo / NowadAIs mistral AI y NVIDIA lanzan el modelo 12B NeMo – Notas clave Mistral AI y NVIDIA han colaborado para crear el modelo 12B NeMo. NeMo cuenta con una ventana de contexto […]

Los 10 mejores generadores de vídeo AI para 2024

Last Updated on julio 26, 2024 12:53 pm by Laszlo Szabo / NowadAIs | Published on julio 21, 2024 by Laszlo Szabo / NowadAIs Los 10 mejores generadores de vídeo con IA para 2024 – Notas clave Los generadores de vídeo de IA han transformado la creación de contenidos de vídeo, haciéndola más eficiente y […]

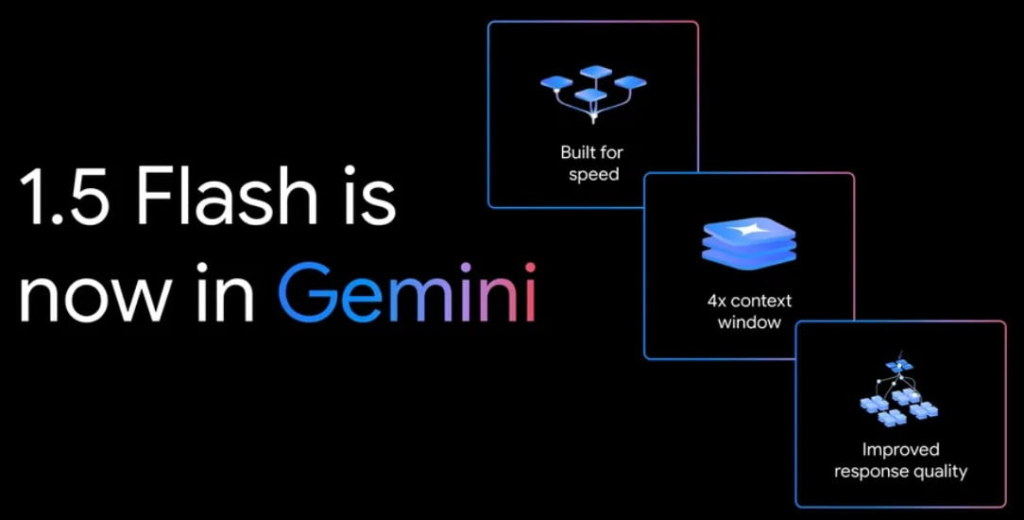

Todos los detalles importantes de la actualización Google Gemini 1.5

Last Updated on julio 26, 2024 11:02 am by Laszlo Szabo / NowadAIs | Published on julio 26, 2024 by Laszlo Szabo / NowadAIs Todos los detalles importantes de la actualización Google Gemini 1.5 – Notas clave Google Gemini 1.5 introduce mejoras significativas en las capacidades de IA. Ventana de contexto ampliada de 8K a […]

Proyecto Strawberry de OpenAI: La búsqueda secreta del razonamiento humano en la IA

Last Updated on julio 17, 2024 11:44 am by Laszlo Szabo / NowadAIs | Published on julio 17, 2024 by Laszlo Szabo / NowadAIs Proyecto Strawberry de OpenAI: La búsqueda secreta del razonamiento humano en la IA – Notas clave OpenAI está desarrollando el “Proyecto Strawberry” para mejorar el razonamiento y la autonomía de la […]

Elon Musk planea construir JARVIS: Grok 2 y Grok 3 de xAI por delante

Last Updated on julio 11, 2024 1:04 pm by Laszlo Szabo / NowadAIs | Published on julio 11, 2024 by Laszlo Szabo / NowadAIs Elon Musk planea construir JARVIS: Grok 2 y Grok 3 de xAI por delante – Notas clave Grok 2 saldrá a la venta en agosto; Grok 3 se espera para finales […]

LivePortrait: De imágenes estáticas a animaciones dinámicas de retratos con IA

Last Updated on julio 10, 2024 11:07 am by Laszlo Szabo / NowadAIs | Published on julio 10, 2024 by Laszlo Szabo / NowadAIs LivePortrait: De imágenes estáticas a animaciones dinámicas de retratos con IA – Notas clave LivePortrait es un marco de animación de retratos basado en IA. Desarrollado por Kuaishou Technology, la Universidad […]

El modelo Llama 3 405B ya está disponible para que lo elijan los usuarios de WhatsApp Beta

Last Updated on julio 1, 2024 1:03 pm by Laszlo Szabo / NowadAIs | Published on julio 1, 2024 by Laszlo Szabo / NowadAIs El modelo Llama 3 405B ya está disponible para que lo elijan los usuarios de WhatsApp Beta – Notas clave WhatsApp Beta para Android incluye Meta AI con los modelos Llama […]

L4GM de Nvidia: objetos animados a partir de vídeo en segundos

Last Updated on junio 27, 2024 11:00 am by Laszlo Szabo / NowadAIs | Published on junio 27, 2024 by Laszlo Szabo / NowadAIs L4GM de Nvidia: Objetos animados a partir de vídeo en segundos – Notas clave L4GM de Nvidia son las siglas de Large 4D Gaussian Reconstruction Model. Integra la reconstrucción 3D con […]

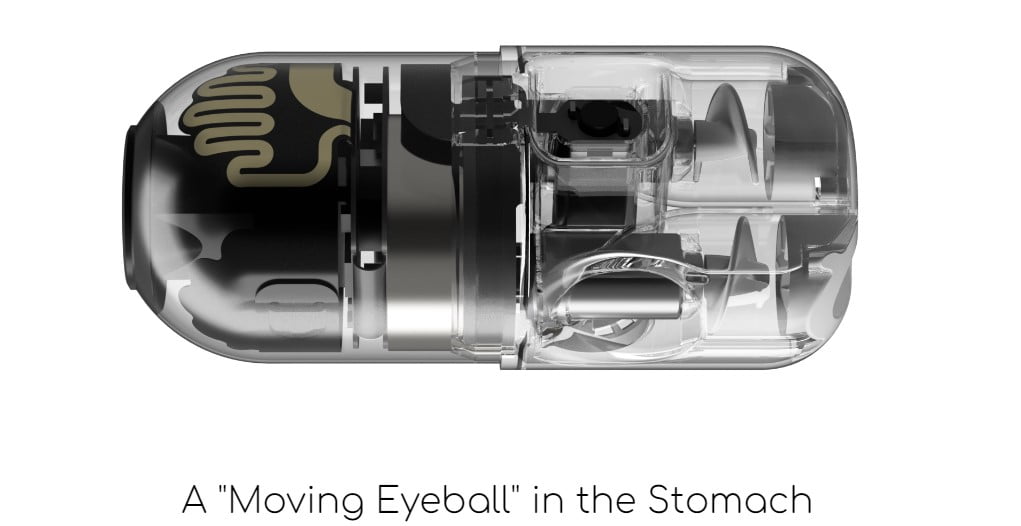

Tragar un robot en lugar de endoscopia: Pillbot transforma la gastroenterología

Last Updated on junio 26, 2024 12:59 pm by Laszlo Szabo / NowadAIs | Published on junio 26, 2024 by Laszlo Szabo / NowadAIs Tráguese un robot en lugar de la endoscopia: Pillbot transforma la gastroenterología – Notas clave Pillbot es una cápsula robótica ingerible desarrollada por Endiatx. Está diseñada para ofrecer una alternativa no […]

Da rienda suelta a tu creatividad con el generador de vídeo Gen-3 Alpha AI de Runway

Last Updated on junio 26, 2024 8:06 am by Laszlo Szabo / NowadAIs | Published on junio 19, 2024 by Laszlo Szabo / NowadAIs Da rienda suelta a tu creatividad con el generador de vídeo Gen-3 Alpha AI de Runway – Notas clave Gen-3 Alpha de Runway: El último modelo de generación de texto a […]